최근 Enterprise IT 환경은 단일 클라우드 제공업체에 의존하던 시대를 지나, 각 플랫폼의 고유한 강점을 결합하는 멀티 클라우드 시대로 완전히 진입하였으며, 2026년에 이르러 네트워크는 단순한 데이터 전송 통로를 넘어, 인공지능(AI) 에이전트와 핵심 애플리케이션을 연결하고 보호하며 관리하는 중추적인 통합 계층으로 진화했습니다.

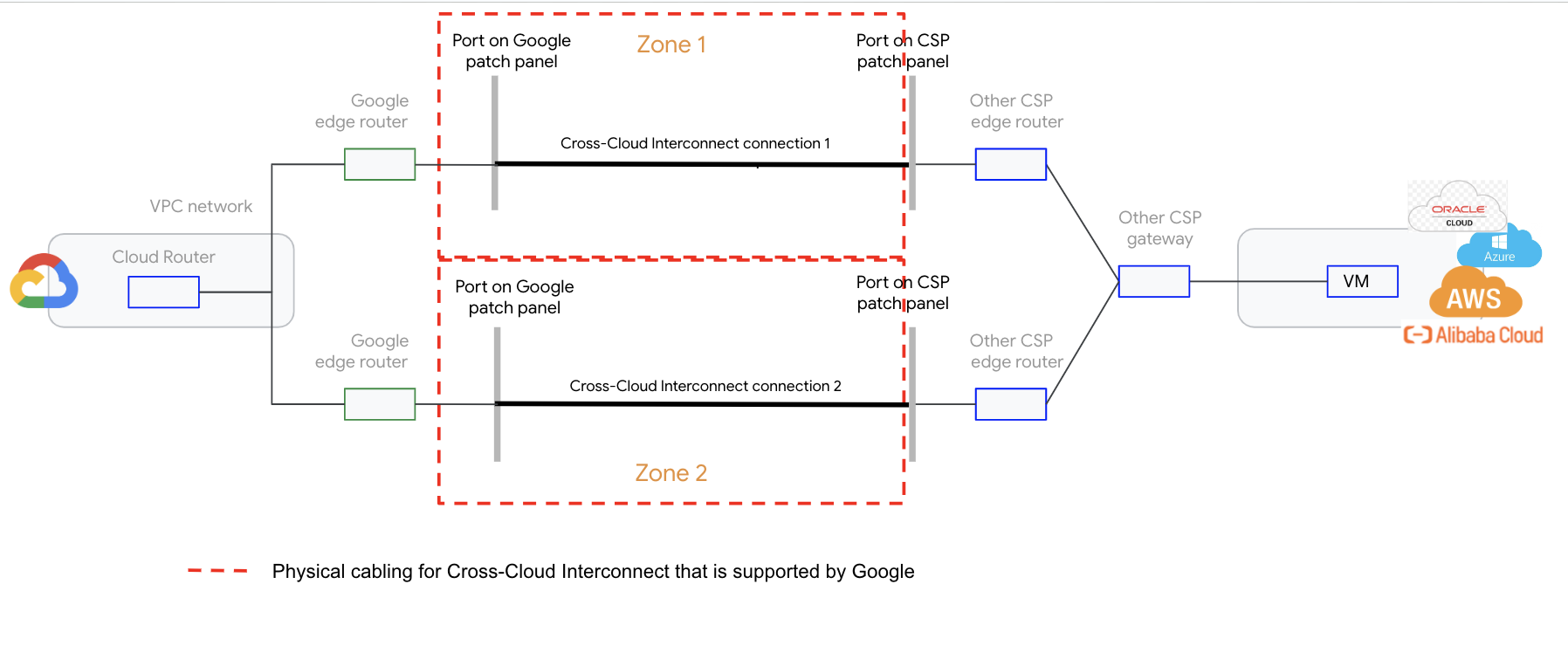

이러한 기술적 흐름 속에서 구글 클라우드의 Cross-Cloud Interconnect(CCI)는 구글 클라우드와 아마존 웹 서비스(AWS), 마이크로소프트 애저(Azure), 오라클 클라우드 인프라스트럭처(OCI), 알리바바 클라우드 등 주요 클라우드 서비스 제공업체(CSP) 간에 고대역폭의 전용 물리적 연결을 제공하는 핵심 솔루션으로 자리 잡았습니다.

Interconnect의 기술적 설계 원칙부터 2026년에 업데이트된 최신 시장 동향, 그리고 구축 및 검증 프로세스 전반을 심층적으로 분석하였습니다.

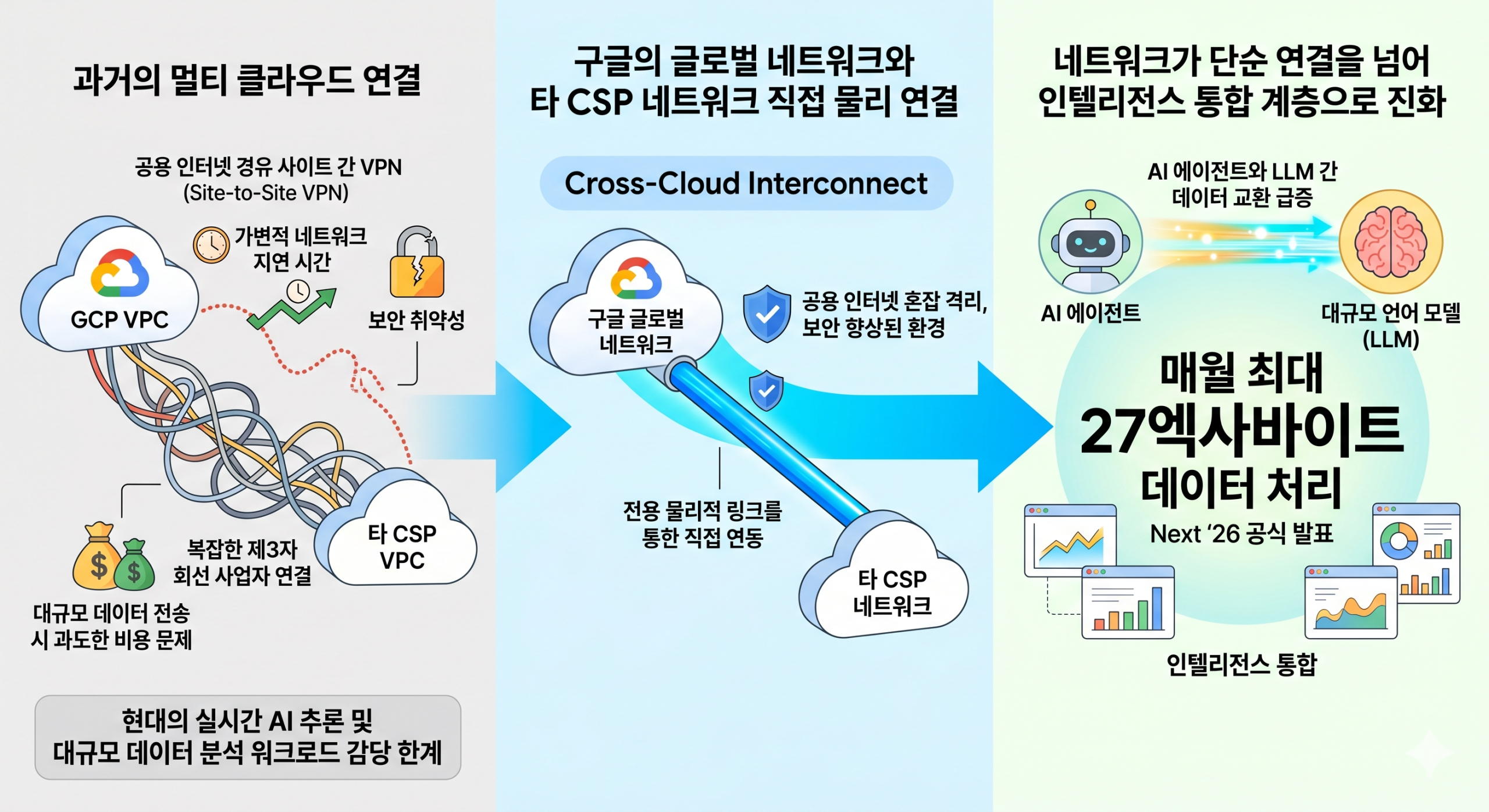

1. 멀티 클라우드 연결의 진화와 Cross-Cloud Interconnect의 부상

과거의 멀티 클라우드 연결은 주로 공용 인터넷을 경유하는 사이트 간 VPN(Site-to-Site VPN)이나 제3자 회선 사업자를 통한 복잡한 물리적 연결에 의존해 왔습니다.

그러나 이러한 방식은 가변적인 네트워크 지연 시간, 보안 취약성, 그리고 대규모 데이터 전송 시 발생하는 과도한 비용 문제로 인해 현대의 실시간 AI 추론이나 대규모 데이터 분석 워크로드를 감당하기에 한계가 있습니다.

구글 클라우드는 이러한 페인 포인트를 해결하기 위해 구글의 글로벌 네트워크와 타 CSP의 네트워크를 직접 물리적으로 연결하는 Cross-Cloud Interconnect 서비스 상픔을 출시하였습니다.

Cross-Cloud Interconnect를 통해 기업은 구글 가상 사설 클라우드(VPC)와 타 CSP 내의 네트워크를 직접 연동할 수 있으며, 이는 전용 물리적 링크를 통해 이루어지므로 공용 인터넷의 혼잡으로부터 완전히 격리된 보안이 향상된 환경을 제공니다.

Next ’26에서 구글 클라우드의 Cross-Cloud Network는 현재 매월 최대 27엑사바이트의 데이터를 처리하고 있다고 공식 발표했습니다. 이는 AI 에이전트와 대규모 언어 모델(LLM) 간의 데이터 교환이 급증하면서 네트워크가 단순한 연결을 넘어 인텔리전스의 통합 계층으로 진화했음을 보여주고 있습니다.

1.1 전략적 이점 및 아키텍처적 가치

Cross-Cloud Interconnect의 도입은 단순한 연결성 확보 이상의 전략적 가치를 제공합니다.

첫번째, 특정 벤더에 대한 종속성(Vendor Lock-in)을 방지하고 비즈니스 논리와 데이터 저장소를 최적의 클라우드 플랫폼에 분산 배치할 수 있는 유연성을 제공합니다.

두번째, 물리적으로 이중화된 경로를 통해 한쪽 클라우드 제공업체의 장애 발생 시에도 서비스 연속성을 보장하는 강력한 재해 복구(DR) 아키텍처를 구현할 수 있습니다.

세번째, 전용 회선을 통한 데이터 전송은 공용 인터넷 egress 비용 대비 예측 가능한 비용 구조를 제공하며, 대용량 트래픽 처리 시 비용 효율성을 극대화할 수 있습니다.

| 주요 비교 항목 | Cross-Cloud Interconnect | 공용 인터넷 VPN | 제3자 패브릭 연결 |

| 연결 방식 | 전용 물리적 연결 (L1/L2) | 공용 인터넷 터널링 (L3) | 중간 사업자 경유 논리적 연결 |

| 대역폭 확장성 | 최대 3.2 Tbps (400G x 8) | 일반적으로 수 Gbps 제한 | 사업자 제공 범위 내 가변적 |

| 지연 시간 | 매우 낮고 고정적 | 가변적이고 예측 불가능 | 중간 노드로 인한 추가 지연 발생 |

| 보안성 | 물리적 격리 및 MACsec 지원 | 암호화 필요 (인터넷 노출) | 사업자 보안 정책 의존 |

| 관리 복잡성 | 구글 관리형 (단일 창구) | 상대적으로 낮음 | 여러 벤더와 개별 계약 필요 |

2. Cross-Cloud Interconnect의 핵심 기술 사양

Cross-Cloud Interconnect는 엔터프라이즈의 요구 사항에 따라 20 Gb/s, 100 Gb/s, 그리고 최신 표준인 400 Gb/s의 물리적 링크 속도를 지원합니다.

각 링크는 링크 어그리게이션(LAG)을 통해 최대 8개까지 묶어 단일 논리적 연결로 구성할 수 있으며, 이를 통해 이론적으로 최대 3,200 Gb/s의 대역폭의 네트워크 구성이 가능합니다.

2.1 대역폭 및 회선 구성 옵션

네트워크 설계는 워크로드의 특성에 따라 다음과 같은 방식으로 구성할 수 있습니다.

20 Gb/s에서 80 Gb/s 사이의 대역폭이 필요한 경우 10 Gb/s 회선을 2개에서 8개까지 조합하며, 초고용량 데이터 센터 간 연결이 필요한 경우에는 400 Gb/s 회선을 활용하여 테라비트급 전송 환경을 구축합니다. 이러한 구성은 특히 전 세계의 다양한 멀티 클라우드 리전과 가용 영역 간의 통합된 네트워크 환경을 구축하는 데 필수적이다.네트워크 설계는 워크로드의 특성에 따라 다음과 같이 구성될 수 있습니다.

| 회선 기본 단위 | 신청 가능 회선 수 | 총 대역폭 범위 | 물리적 인터페이스 요건 |

| 10 Gb/s | 1 ~ 8 회선 | 10 Gb/s ~ 80 Gb/s | 10GBASE |

| 100 Gb/s | 1 ~ 8 회선 | 100 Gb/s ~ 800 Gb/s | 100GBASE |

| 400 Gb/s | 1 ~ 8 회선 | 400 Gb/s ~ 3,200 Gb/s | 400GBASE |

2.2 서비스 수준 계약(SLA) 및 가용성 모델

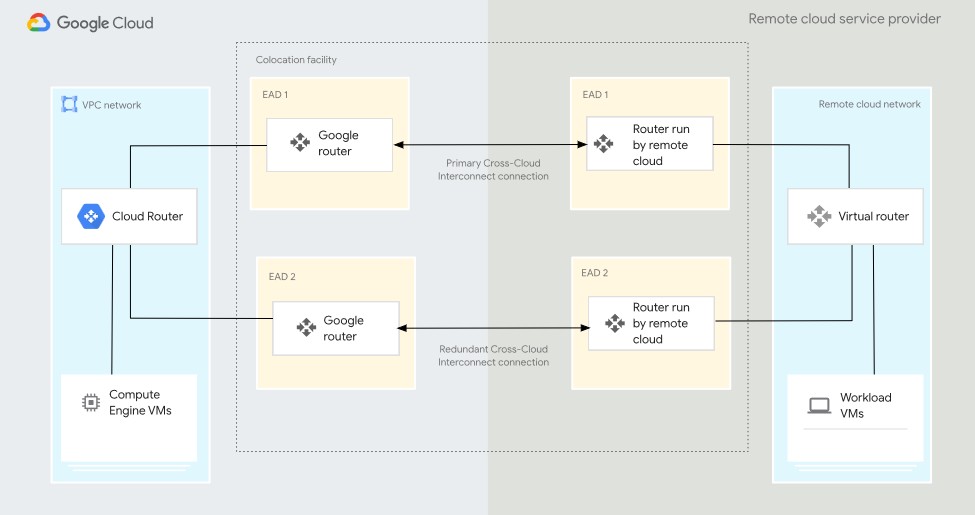

Cross-Cloud Interconnect는 구글 클라우드와 AWS 간의 공동 책임 모델을 기반으로 하며, 구글의 인프라가 타 클라우드 제공업체로 전송되는 지점(Panel)까지만 구글의 SLA가 적용되며, 높은 신뢰성을 보장하기 위해 구글은 두 가지 주요 가용성 접근 방식을 권장합니다.

첫번째, 최소 요구 사항(Minimum Requirement) 모델은 단일 대도시권(Metro) 내의 서로 다른 두 개의 에지 가용성 도메인(Edge Availability Domain)에 연결을 배치하는 방식입니다.

이를 통해 99.9%의 가용성을 확보할 수 있으며, 이는 비즈니스 크리티컬하지 않은 일반적인 운영 환경에 적합합니다.

에지 가용성 도메인은 대도시권 내의 영역으로, 동일 권역의 두 도메인이 유지보수로 인해 동시에 중단되지 않도록 설계되어 있습니다.

두번째, 고가용성(High Availability) 모델은 중요도가 매우 높은 애플리케이션을 위한 구성으로, 서로 다른 두 대도시권에 각각 한 쌍의 연결을 배치합니다.

각 대도시권 내에서도 서로 다른 에지 가용성 도메인을 사용하여 총 4개의 물리적 연결을 구성하며, 이 방식을 통해 99.99%의 가용성을 보장합니다.

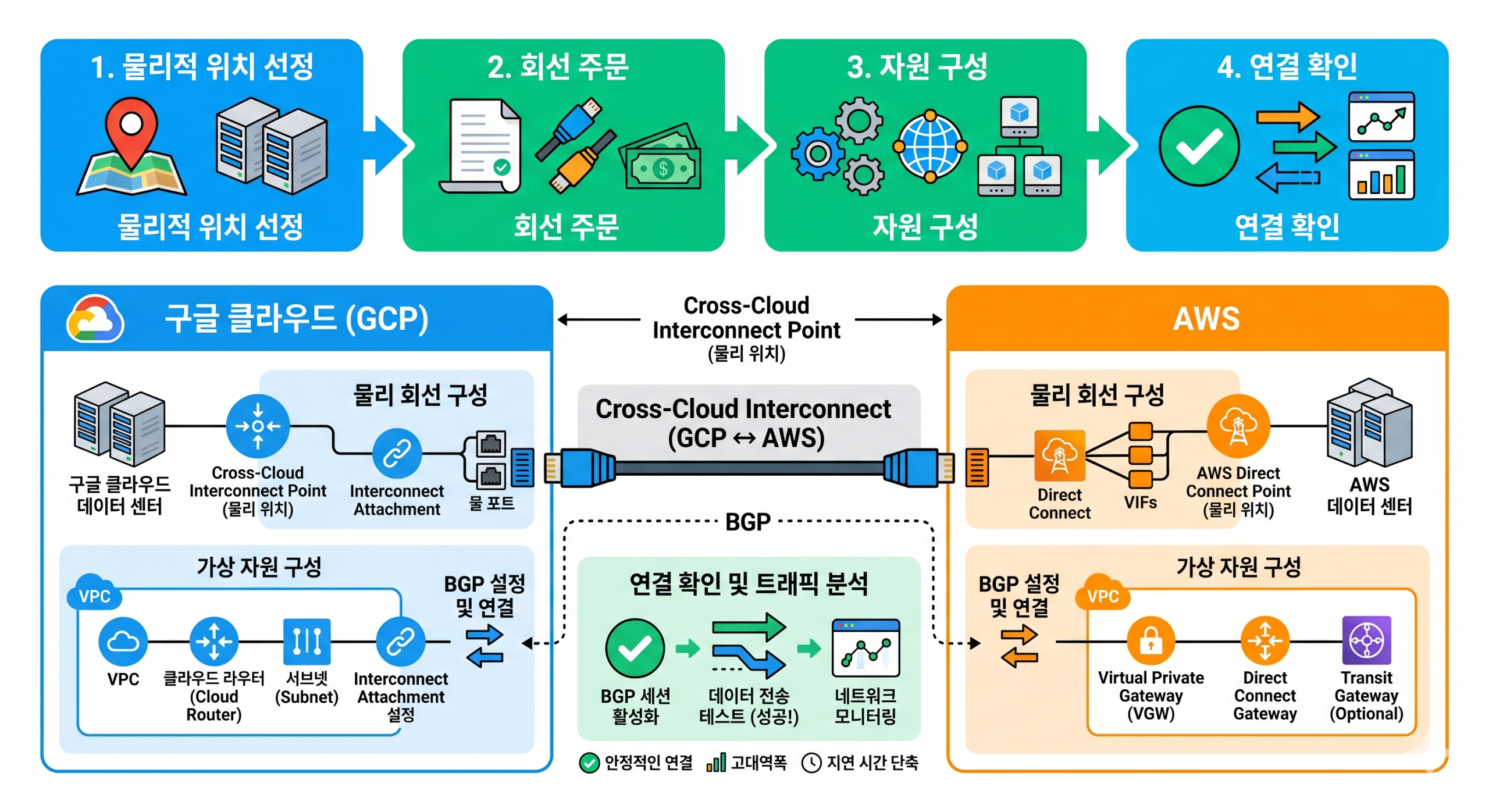

3. 구축 절차 단계별 분석: 구글 클라우드와 AWS 연결

Cross-Cloud Interconnect를 성공적으로 구축하기 위해서는 구글 클라우드와 상대 클라우드에서의 설정 작업이 유기적으로 연결되어야 합니다. (본 사례에서는 GCP, AWS간의 연결입니다.)

전반적인 프로세스는 물리적 위치 선정, 회선 주문, 자원 구성, 그리고 연결 확인의 순서로 진행되고 있습니다.

단계 1: 위치 선정 및 물리적 회선 주문 (GCP)

구축의 시작은 구글과 AWS의 포트가 위치할 물리적 장소를 식별하는 것입니다.

서울 리전의 경우 LG Uplus 평촌 IDC와 KINX 가산 IDC가 주요 로케이션으로 서비스가 제공되고 있으며, GCP 콘솔에서 Cross-Cloud Interconnect 회선 주문을 완료합니다. 신청이 완료되면 구글 클라우드 인터커넥트 운영팀(Interconnect Operations) email이 수신됩니다.

단계 2: AWS 리소스 구성 및 LOA-CFA 획득

GCP Cross-Cloud Interconnect 회선 주문 완료후 AWS 콘솔엣서 이에 상응하는 AWS 리전을 선택하여 Direct Connect 연결을 신청합니다.

신청을 완료하면 LOA-CFA가 생성되며, 생성된 LOA-CFA 다운로드 받은후 구글 클라우드 인터커넥트 운영팀(Interconnect Operations)에 email을 회신해야 합니다.

단계 3: 구글 클라우드 라우터 및 논리적 자원 구성

물리적 연결 작업이 진행되는 동안, Google Cloud 내에서 논리적 통로인 가상 인터페이스를 설정해야 합니다.

Cloud Router 생성, VLAN Attachment 생성, BGP 세션 설정 순서대로 진행합니다.

단계 4: AWS 가상 인터페이스(VIF) 구성

AWS 측에서도 생성된 Direct Connect 회선 상에 실제 트래픽 전송을 위한 가상 인터페이스(Virtual Interface)를 생성해야 합니다.

이 과정에서 BGP 피어링 설정 및 VLAN ID 지정이 이루어지며, GCP에서 설정된 값들과 일치하도록 구성해야 정상적인 라우팅 정보 전파가 가능합니다.

4. 결론 및 전략적 제언

Cross-Cloud Interconnect는 단순한 네트워크 회선을 초월하여, 기업이 멀티 클라우드 환경에서 데이터 주권을 확보하고 비즈니스 회복탄력성을 극대화하는 전략적 교두보로서의 역할을 수행합니다.

2026년의 변화된 기술 및 비용 환경을 고려할 때, 기업은 다음과 같은 전략적 접근 방식을 수립할 필요가 있습니다.

첫번째, 구축 속도와 관리 편의성을 우선적으로 고려하는 경우, 최근에 출시된 ‘Partner Cross-Cloud Interconnect’의 도입을 적극적으로 검토해야 합니다. 특히 10 Gbps 미만의 대역폭을 요구하거나 네트워크 전문 인력이 부족한 조직에게 최적의 대안을 제시할 수 있습니다.

작성 시점 지원 되는 Region은 5개입니다. (us-west-1, us-west-2, us-east-1, eu-west-2, eu-central-1)

두번째, 99.99%의 가용성을 목표로 하는 엔터프라이즈의 경우, 지리적으로 분리된 두 대도시권에 각각 한 쌍의 인터커넥트를 배치하는 고가용성 설계를 원칙으로 확립해야 합니다.

이는 단순한 권장 사항이 아니라, 엄격한 SLA를 준수하기 위한 필수적인 요건입니다.

세번째, 성능 최적화를 위하여 MTU 일치 작업과 Cloud Monitoring 기반의 정기적인 대역폭 테스트를 의무적으로 수행하고, 클라우드 네트워크 인사이트(Cloud Network Insights)와 같은 최신 모니터링 도구를 활용하여 AI 에이전트와 애플리케이션 간의 지연 시간을 실시간으로 관리해야 합니다.

구글 클라우드 Cross-Cloud Interconnect는 2026년 멀티 클라우드 여정에서 핵심적인 고속도로와 같으며, 이를 어떻게 설계하고 운용하는지가 곧 기업의 디지털 경쟁력을 결정하는 핵심 요소가 될 것입니다.

자세한 구축 방법이 필요 하시다면 Cross-Cloud Interconnect 백서를 참고하시기 바랍니다.