Google Next 2026 GKE – 05 Accelerator Networking with NCCL, gIB, and A4X

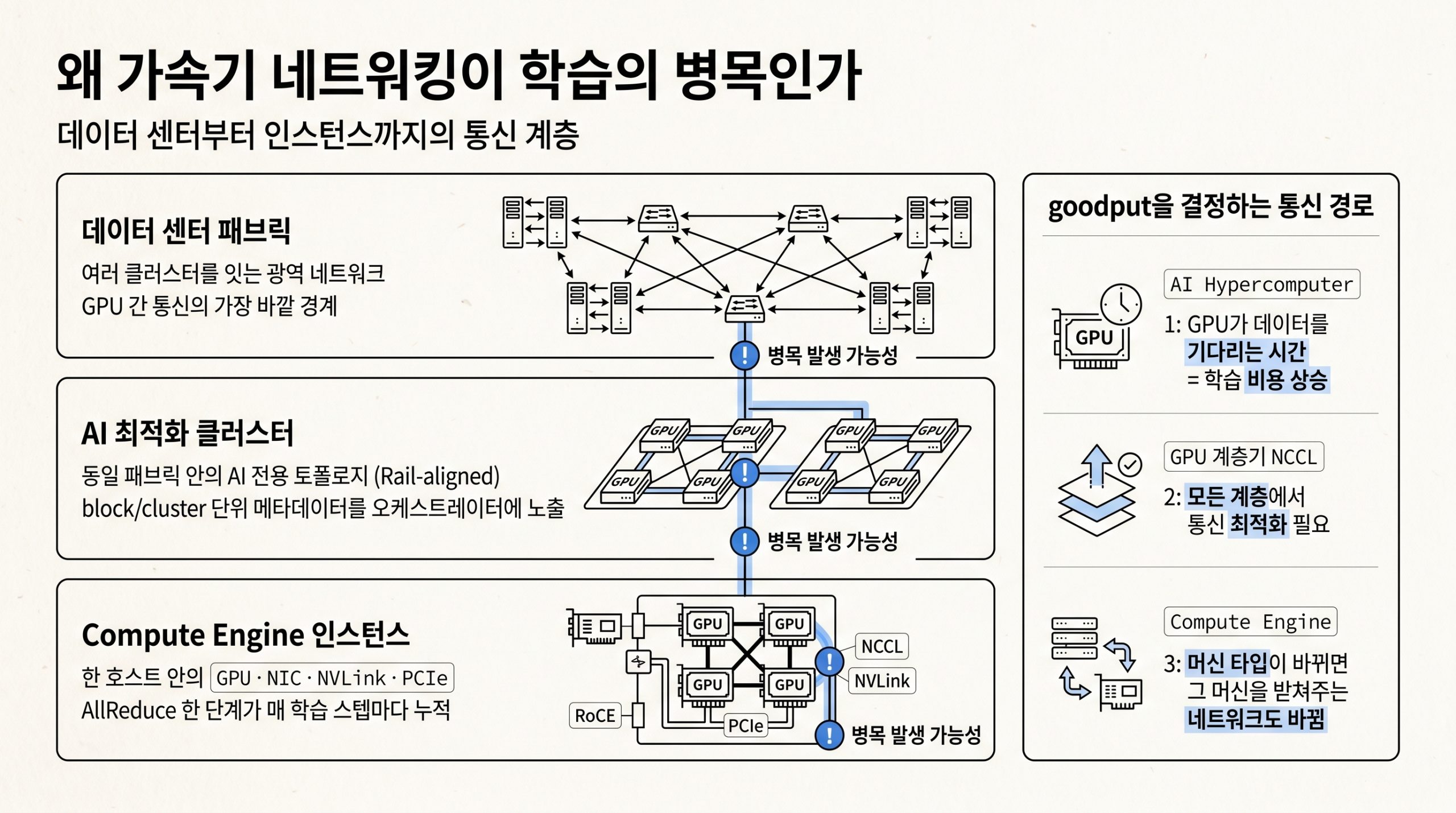

5편: 가속기 네트워킹, NCCL과 gIB와 A4X 대규모 학습은 가속기 한 장이 아니라 수백·수천 장이 함께 한 모델을 학습합니다. 이때 GPU 사이의 통신이 학습 시간을 결정합니다. AllReduce 한 단계가 길어지면 매 스텝마다 그만큼이 누적되고, 결국 토큰당 학습 비용이 올라갑니다. AI Hypercomputer는 이 통신 경로를 하드웨어와 소프트웨어 양쪽에서 손봤습니다. 본 글은 GPU-to-GPU 트래픽을 떠받치는 Rail-aligned 토폴로지, NCCL과…