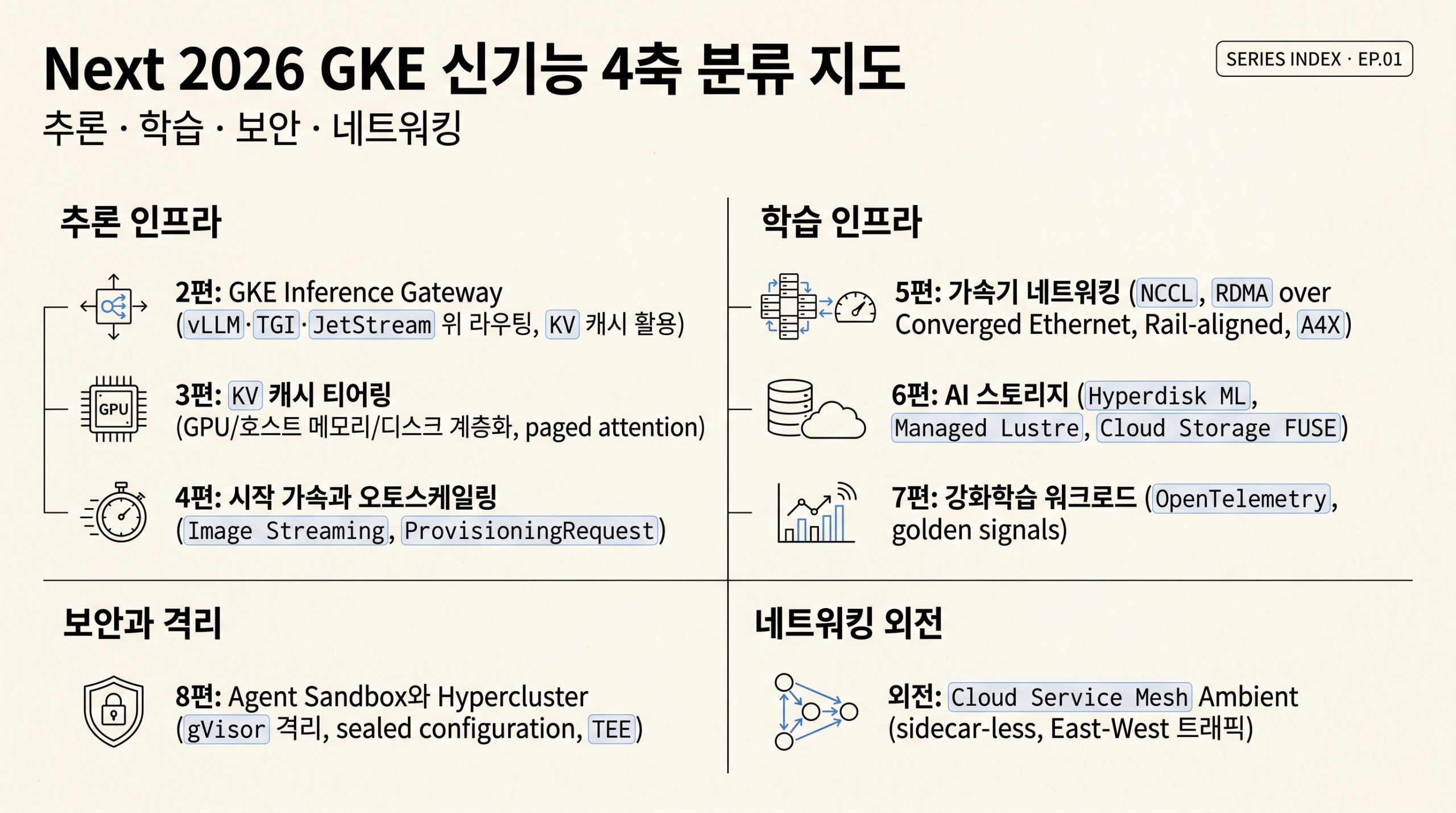

Google Next 2026 GKE – 02 Standardizing LLM Serving with Inference Gateway

2편: GKE Inference Gateway로 LLM 서빙 표준화 GKE Inference Gateway는 구글 쿠버네티스 엔진(GKE) 위에서 대규모 언어 모델(LLM) 서빙을 표준화하는 추론 최적화 로드밸런서입니다. Google Cloud Next 2026에서 강조된 이 컴포넌트는 vLLM·TGI·JetStream 같은 모델 서버 위에 얹혀, 일반 HTTP 로드밸런서가 보지 못하는 KV 캐시 점유율, 요청 큐 길이, LoRA 어댑터 가용성 같은 추론 고유 신호를 라우팅 결정에…