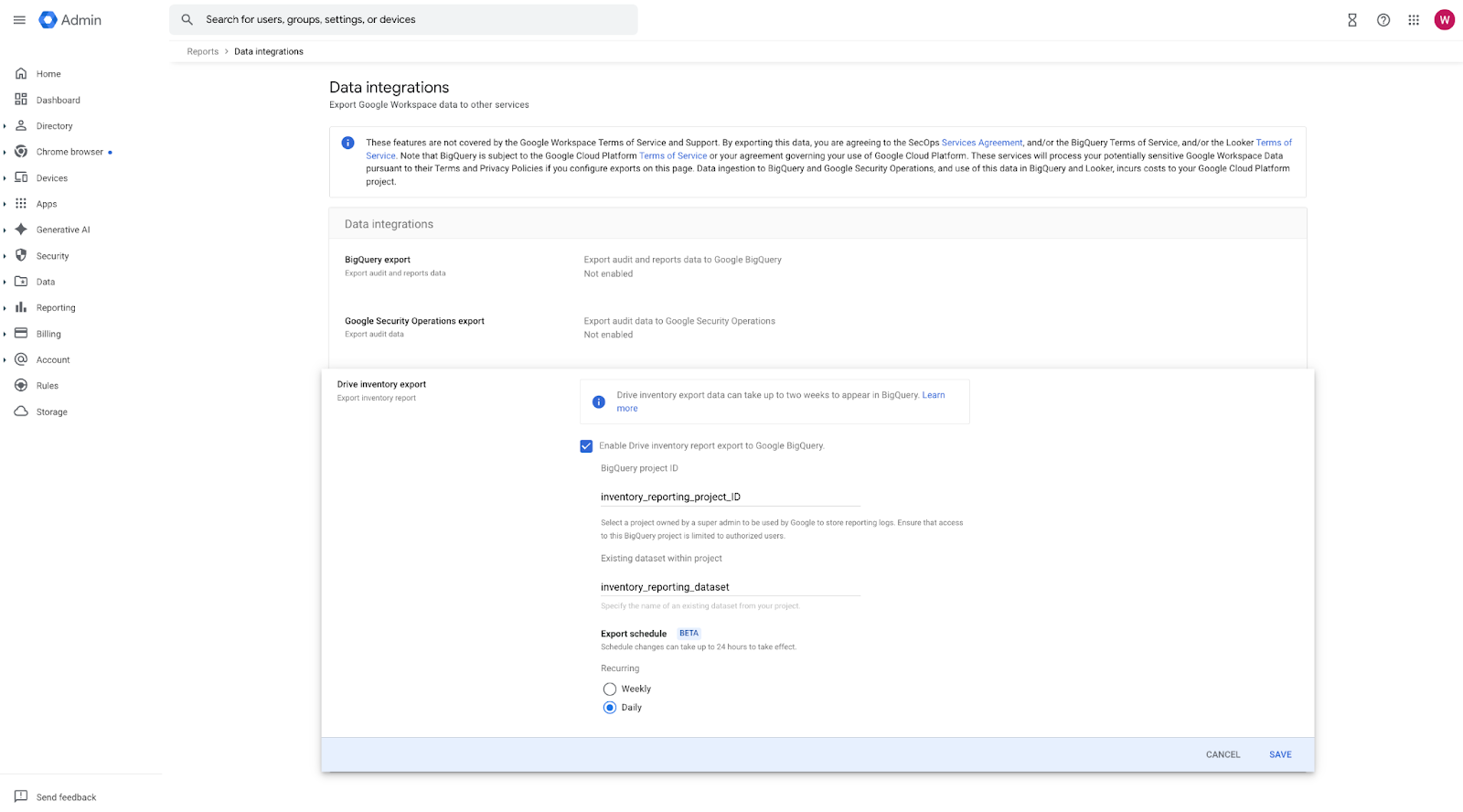

[Admin] Google Drive 인벤토리 보고를 위한 일일 내보내기 기능 오픈 베타 제공

📌 지원되는 버전 : Google Workspace Enterprise Standard 이상 Google 드라이브 인벤토리 보고 기능은 이제 기존 주간 주기 외에도 드라이브 데이터 애셋을 BigQuery로 매일 내보내는 기능을 지원합니다. API를 사용하는 것과 달리, BigQuery로 인벤토리 보고서를 내보내면 관리자가 데이터를 더욱 심층적으로 이해하고 데이터 분류, 액세스 및 사용 방식에 대한 통찰력을 얻을 수 있습니다. 이러한 측정항목을 이해하면 관리자가…